Wo sind bloß die guten alten Zeiten hin, in denen es schon ausreichte, ein paar gute Keywords auf der Webseite zu platzieren und so bei Suchanfragen von Interessenten in den Suchmaschinen gefunden zu werden?

Beim Gedanken daran ist es so ähnlich, wie wenn man sich Fußballspiele von alten Weltmeisterschaften des vergangenen Jahrtausends ansieht. Viele denken sich, dass es sich dabei um eine andere Sportart handelt.

Genau das ist auch bei SEO der Fall. Wer heute noch auf den ersten Plätzen in den Suchmaschinen landen möchte, benötigt umfangreiche Kenntnisse, was dazu alles erforderlich ist. Vor allem technisches SEO spielt dabei eine immer größere Rolle.

Was ist technisches SEO?

Technisches SEO, oder im englischen Original Technical SEO, ist für die Performance der eigenen Webseite ungefähr so wichtig wie ein gutes Straßennetz für den städtischen Verkehr. Nur wenn die Infrastruktur entsprechend gut ausgebaut ist, kann der Verkehr fließen. Das Gleiche ist auch bei einer Webseite der Fall. Deshalb beschäftigt sich technisches SEO vor allem mit der SEO-Infrastruktur.

Eines ist klar: Ohne Content Marketing geht nach wie vor gar nichts. Nur wer gute und exklusive Inhalte auf seiner Webseite bietet, kann damit auch Fans und in weiterer Folge Kunden gewinnen. Doch damit dieser Content auch tatsächlich bei den Usern ankommt, ist eine entsprechende technische Struktur der Seite erforderlich. Diese hilft in weiterer Folge vor allem auch den Suchmaschinen – allen voran Google – die Inhalte der Webseite richtig zu interpretieren.

Das Ziel von Google ist es, Nutzer bei Suchanfragen das bestmögliche Ergebnis zu liefern. Dafür ist es erforderlich, den passenden Content anzubieten. Doch wenn sich beispielsweise just in jenem Text eine Menge toter Links befinden, die nirgendwo hinführen, ist das ein klares Zeichen dafür, dass die Webseite seit längerer Zeit nicht mehr gepflegt wurde. In diesem Fall erhält ein Mitbewerber mit aktuellen Infos logischerweise den Vorzug bei der Platzierung in den SERPs (Abkürzung für „Search Engine Result Page“).

Das Herzstück von Technical SEO: Die Google Search Console

Wer sich mit dem Thema Technical SEO beschäftigt, kommt nicht an der Google Search Console vorbei. Alle, die schon länger im Business sind, kennen dieses Werkzeug auch noch unter der alten Bezeichnung „Google Webmaster Tools“.

Bei der Google Search Console handelt es sich um eine Oberfläche für Webmaster, die unterschiedliche Daten und Einstellungen für die Google Suchergebnisse einer Webseite bereithält. Die Suchergebnisse können zwar mit der Console nicht direkt beeinflusst werden, allerdings liefert sie die Datengrundlage, anhand der in weiterer Folge entsprechende Optimierungen vorgenommen werden können.

Viele Webmaster bezeichnen die Google Search Console deshalb auch einfach als den direktesten Zugang zu Google. Neue Seiten können hier schnell und einfach in den Index aufgenommen und Fehler, die von Google erkannt wurden, behoben werden.

Zu erreichen ist sie unter https://search.google.com/search-console. Beim erstmaligen Aufruf kann eine sogenannte Property angelegt werden. Dabei kann es sich entweder um eine Domain oder nur um eine bestimmte URL-Präfix handeln. Während bei der Domain die Daten von allen Subdomains und Protokollarten (http sowie https) untersucht werden, wird bei der URL-Präfix nur eine ganz bestimmte Adresse analysiert.

Die Search Console untergliedert sich in mehrere Unterbereiche, die jeweils Informationen zu so unterschiedlichen Themen wie beispielsweise Sicherheitsprobleme, Geschwindigkeit, Nutzerfreundlichkeit oder eingehende Links von anderen Webseiten enthalten.

Die Übersichtsseite bietet einen schnellen Überblick über die wichtigsten Daten der Webseite:

- Ein grafischer Überblick über die Suchanfragen der letzten drei Monate.

- Ein Chart mit der Anzahl der Seiten, die sich im Google Index befinden und von Seiten mit Fehlern.

- Verbesserungsvorschläge zu den Themen Geschwindigkeit, Mobilfreundlichkeit und strukturierte Daten in tabellarischer Form.

robots.txt: Die erste Anlaufstelle für Crawler

Bei der robots.txt handelt es sich um eine Textdatei, in der hinterlegt werden kann, welche Verzeichnisse von den Suchmaschinen gelesen werden sollen und welche nicht. Allerdings besteht dabei keine Garantie, dass sich die Suchmaschinen auch tatsächlich an die hinterlegten Verbote halten. Google und Bing geben zwar an, dass sie die Angaben der Datei beachten, verpflichtet sind sie aber nicht dazu.

Damit Google die Seite finden kann, muss sie sich im Hauptverzeichnis der Domain befinden. Pro Hauptdomain ist nur eine Version der robots.txt möglich.

Die Datei beinhaltet jeweils zwei Elemente. Zunächst wird durch den Befehl „User-Agent“ angegeben, welcher Bot sich durch die folgenden Befehle angesprochen fühlen soll. Darunter finden sich die Befehle, welche Dateien bei der Suche ein- und ausgeschlossen werden sollen.

Hier ein Beispiel dazu:

User-agent: Googlebot

Disallow: /verzeichnisA/

Disallow: /verzeichnisB/

In diesem Fall wird dem User-Agent mit den Namen Googlebot (also der Suchmaschine Google) mitgeteilt, dass er nicht auf die Verzeichnisse verzeichnis A und verzeichnisB sowie auf alle darunterliegenden Verzeichnisse zugreifen darf.

URL-Struktur: So lang wie nötig, so kurz wie möglich

Eine wichtige Rolle bei den Suchergebnissen spielt unter anderem auch die URL-Struktur. Deshalb handelt es sich dabei um eine der Kernthemen des Technical SEO. Es ist wichtig, dieses Thema vor allem beim Aufbau von neuen Projekten von Anfang an zu berücksichtigen, denn wenn bereits einmal das Chaos ausgebrochen ist, wird es ungleich schwieriger, wieder Ordnung in die Seite zu bringen.

Idealerweise sollte die URL-Struktur so einfach wie möglich gestaltet sein. Wer beispielsweise nach Informationen zum Thema Raumfahrt sucht, wird sehr wahrscheinlich auf eine URL klicken, die nach dem folgenden Schema aufgebaut ist:

⇒ https://de.wikipedia.org/wiki/Raumfahrt

Weniger wahrscheinlich ist das der Fall, wenn die URL jedoch folgendermaßen aussieht:

⇒ http://www.beispiel.de/index.php?id_sezione=480&sid=34jkk34944f41daa6f849f7

Beim Aufbau der URLs sollten deshalb vor allem folgende Ratschläge berücksichtigt werden:

- Relevante Keywords einbauen

- Auf Lesefreundlichkeit für menschliches Auge achten

- Überflüssige Füllwörter aus der URL streichen

- Sonderzeichen vermeiden (Ausnahme: Der Binde- oder Unterstrich, durch die einzelnen Worte getrennt werden sollten)

- Großschreibung vermeiden

- https:// als Übertragungsprotokoll verwenden

- Vertrauenserweckende Top-Level-Domains auswählen (also primär .com oder .de Domains und nicht Endungen wie beispielsweise .blitz .top oder .academy)

Vor allem ist es aber auch wichtig, sich im Vorfeld eine Struktur zu überlegen und diese in weiterer Folge strikt einzuhalten.

Eine gute Struktur der Webseite verbessert die Crawl-Effizienz

Die Seitenstruktur einer Webseite wird im Technical SEO auch als Sitemap bezeichnet. Sie stellt die Struktur einer kompletten Webseite dar. Dabei sind die jeweiligen Ober- und Unterseiten hierarchisch strukturiert.

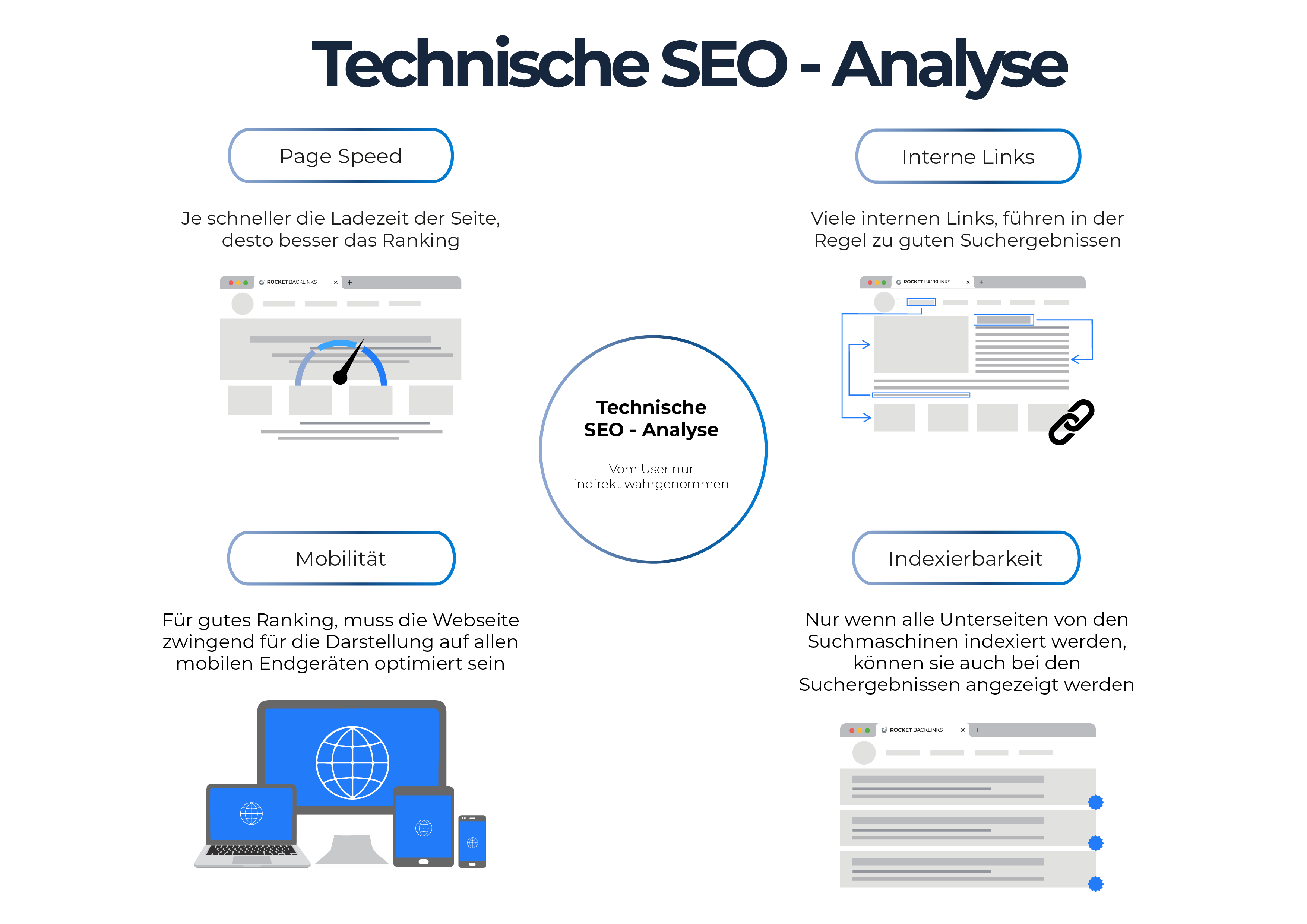

Das macht es sowohl für die User als auch für den Google-Bot nachvollziehbarer, wie die Themen der Webseite zusammengehören. Um die Crawl-Effizienz zu verbessern, ist eine entsprechende Indexierung erforderlich.

Wie die Strukturierung dabei genau erfolgt, ist immer vom jeweiligen Konzept abhängig. Das Hauptmerkmal einer guten Seitenstruktur ist, dass man sich im Vorfeld in die Lage des Besuchers versetzt. Dabei sollte vor allem das Vorwissen der User nicht überbewertet werden. Aus diesem Grund sind interne Verlinkungen wichtig, die dabei behilflich sein können, mögliche Wissenslücken zu schließen.

Ein entscheidendes Kriterium ist darüber hinaus die Klicktiefe. Wichtige Seiten sollten dabei mit möglichst wenig Klicks erreichbar sein und sich in der ersten oder zweiten Hierarchiestufe befinden. Nischenthemen können hingegen auch in der dritten oder vierten Stufe Platz finden. Bei kleinen Projekten sollte die Tiefe jedenfalls möglichst flach gehalten werden.

Für das Technical SEO ist aber vor allem von Bedeutung, womit diese Strukturierung vorgenommen wird. Die beiden wichtigsten Optionen hierfür sind die HTML-Sitemap und die XML-Sitemap.

Seitenstrukturierung mit XML-Sitemap und HTML-Sitemap

Bei der HTML-Sitemap handelt es sich um eine eigene Seite, die sowohl für Nutzer als auch für Crawler eine Einsicht in die Seitenstruktur bietet. Der Link zur HTML-Sitemap befindet sich meistens im Footer, also im untersten Bereich der Seite. Oftmals handelt es sich dabei einfach um eine alphabetische Auflistung der einzelnen Unterseiten. Durch Einrückungen ist es möglich, die Sitemap übersichtlicher zu gestalten.

Ein Beispiel für eine gut angeordnete HTML-Sitemap ist Amazon. Dort sind alle Hauptkategorien und die jeweils wichtigsten Unterkategorien enthalten. Das ermöglicht Besuchern eine einfache Navigation durch die Seite.

Im Gegensatz zur HTML-Sitemap ist die XML-Sitemap für User nicht einsehbar und wird nur für das Crawling der Bots erstellt. Die XML-Sitemap muss dabei über die Google Search Console eingereicht werden. Dabei können auch zusätzliche Angaben wie beispielsweise der Zeitpunkt der letzten Aktualisierung angegeben werden.

Die XML-Sitemap enthält dabei alle URLs einer Website, eine Angabe zum Zeichencode sowie zusätzliche Metadaten. Manche CMS können die XML-Sitemap automatisch erstellen und auf den Server hochladen.

Ist das nicht der Fall, gibt es zahlreiche Tools im Internet, die die automatische Erstellung übernehmen können. Zu den bekanntesten davon zählen unter anderem der „Free Sitemap Generator“ (https://xmlsitemapgenerator.org/) sowie „My Sitemap Generator“ (https://www.mysitemapgenerator.com/).

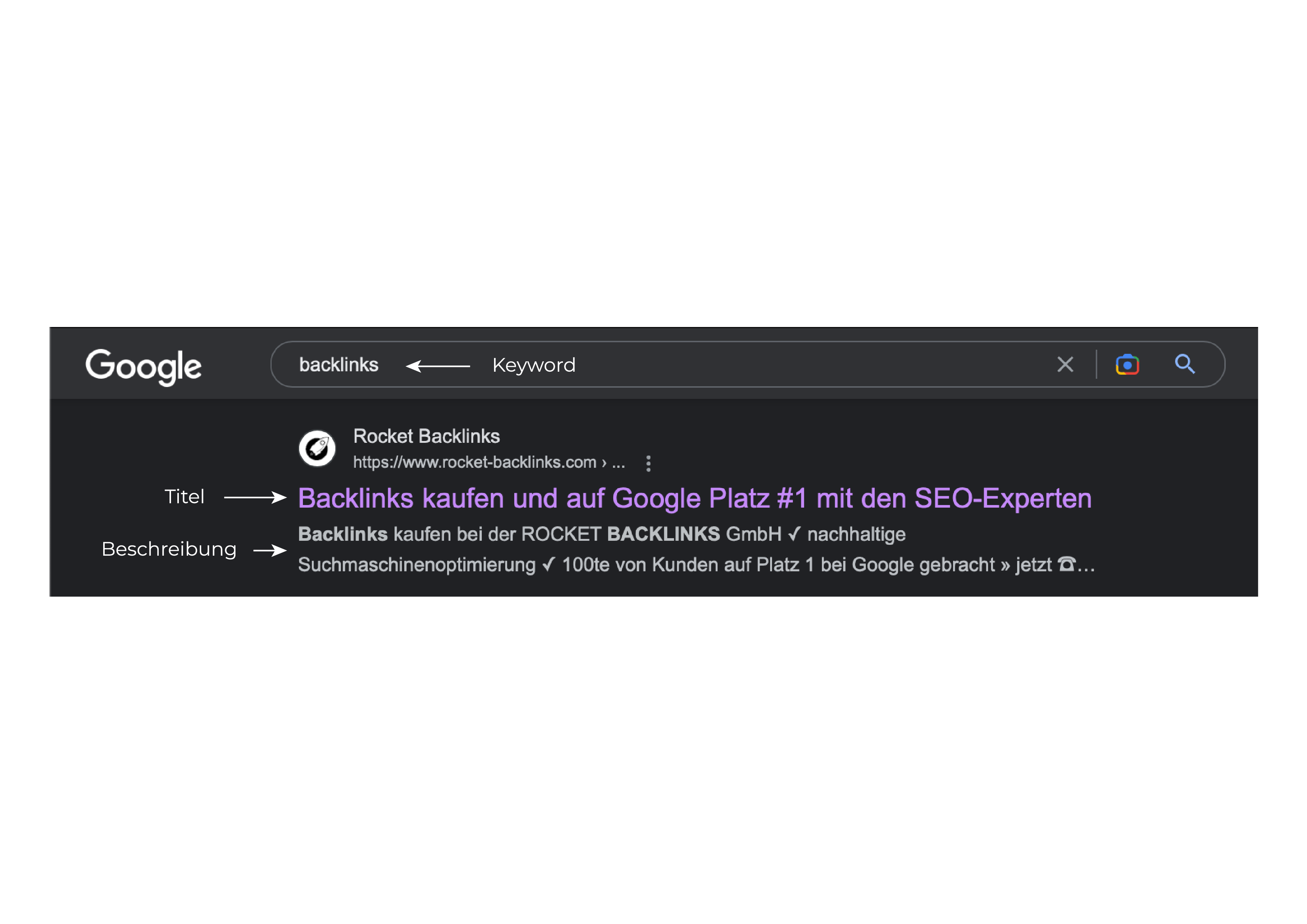

Mit Hilfe von Metatags mit den Suchmaschinen kommunizieren

Bei den Metatags handelt es sich um Informationen zur jeweiligen Webseite, die von den Bots ausgelesen werden können. Genau aus diesem Grund gehören sie auch zum Themengebiet des Technical SEO.

Zu den wichtigsten Bestandteilen der Metatags gehören unter anderem der „Title“, die „Description“ sowie die „Meta-Keywords“. Vor allem der Titel und die Beschreibung spielen eine wichtige Rolle, weil diese genau so auch in den Suchergebnissen angezeigt werden. Die Bedeutung der Meta-Keywords hat jedoch im Laufe der Zeit stark nachgelassen. Somit kann darauf heutzutage gut und gerne verzichtet werden.

Neben dem Titel und der Beschreibung ist es in manchen Fällen auch noch sinnvoll, die folgenden Metatags einzufügen:

- Content Type/Language: Hier wird angegeben, für welche Benutzersprache die Seite bestimmt ist. „Content-Language: de-DE“ kennzeichnet beispielsweise Dokumente für deutschsprachige Benutzer.

- Author: Enthält Angaben zum Herausgeber der Webseite

- Page Topic: Beschreibt das jeweilige Thema der Seite

- Revisit: Gibt dem Bot an, wann die Seite erneut gecrawled werden soll. Diese Anweisung wird allerdings in den meisten Fällen ignoriert.

Weiterleitungen: Das virtuelle „Wir sind umgezogen“-Schild

Weiterleitungen sind aus dem Technical SEO kaum wegzudenken. Sie vereinfachen es den Suchmaschinen-Algorithmen, die richtigen Inhalte zu finden.

Es gibt unterschiedliche Arten von Weiterleitungen. Zu den populärsten zählt dabei die 301-Weiterleitung. Die Aufgabe dieser Weiterleitung ist es, Benutzer und Bots dauerhaft auf eine andere URL weiterzuleiten. Von vielen Seitenbetreibern wurde sie in der jüngeren Geschichte vor allem dazu verwendet, um von der http-Version der Seite auf die https-Version weiterzuleiten.

Wichtig bei dieser Art der Weiterleitung ist aber, Umleitungsketten mit zu vielen Redirects und vor allem Umleitungsschleifen zu vermeiden.

Daneben gibt es aber noch zahlreiche andere Verwendungsmöglichkeiten für die Weiterleitungen. Dazu zählen beispielsweise die Verhinderung toter Links, die Vermeidung von Duplicate Content sowie eine automatisierte Umstellung der Webseite auf die richtige Sprachversion.

Unterschieden wird dabei primär zwischen temporären und dauerhaften Weiterleitungen. Die 302er-Umleitung kommt beispielsweise dann zur Anwendung, wenn die URL-Änderungen nur auf einen bestimmten Zeitraum begrenzt sind.

Zu den bekanntesten dauerhaften Weiterleitungen gehört die 404-Weiterleitung. Dabei handelt es sich um die berühmte Seite, die angezeigt wird, wenn eine bestimmte Seite nicht (mehr) existiert. Mit der Zeit sorgt diese Weiterleitung dafür, dass die entsprechende Seite aus dem Suchmaschinen-Index entfernt wird.

Jede Millisekunde zählt: Pagespeed verbessern

Im digitalen Zeitalter schlagen nicht die Großen die Kleinen, sondern die Schnellen die Langsamen. Dieser bekannte Spruch gilt auch, wenn es um den Speed der Webseite geht.

Nicht nur User fühlen sich durch das langsame Laden von Webseiten gestört, vor allem für Google ist es ebenfalls kein gutes Zeichen und deshalb ebenfalls eine wichtige Komponente im Rahmen von Technical SEO. Der Pagespeed wurde mittlerweile von Google zum offiziellen Ranking-Faktor erhoben. Je schneller die Seite lädt, desto wahrscheinlicher ist es im Zweifelsfall also auch, dass sie weit vorne bei den SERPs aufscheint.

Wichtig bei der Verbesserung des Pagespeeds ist es, die jeweiligen Flaschenhälse rechtzeitig zu erkennen. Dabei kann es sich beispielsweises um einen überlasteten Webserver handeln, der mit zu vielen Anfragen auf einmal zurechtkommen muss. In diesem Fall ist es sinnvoll, die Kapazitäten des Servers nach oben anzupassen.

Falls noch nicht geschehen, sollte der Webserver von HTTP/1.1 auf das Protokoll HTTP/2 umgestellt werden. Dieses wird mittlerweile von allen Browsern unterstützt und hilft dabei, Dateien gleichzeitig über eine einzige Verbindung herunterzuladen.

Auch die Größen der einzelnen Dateien spielen im Zusammenhang mit der Geschwindigkeit einer Webseite eine wichtige Rolle. Die erste Optimierungsquelle sind zumeist überdimensionierte Bilder. Die Probleme könnten sich zum Teil aber auch in den Stylesheet- und Skript-Dateien finden.

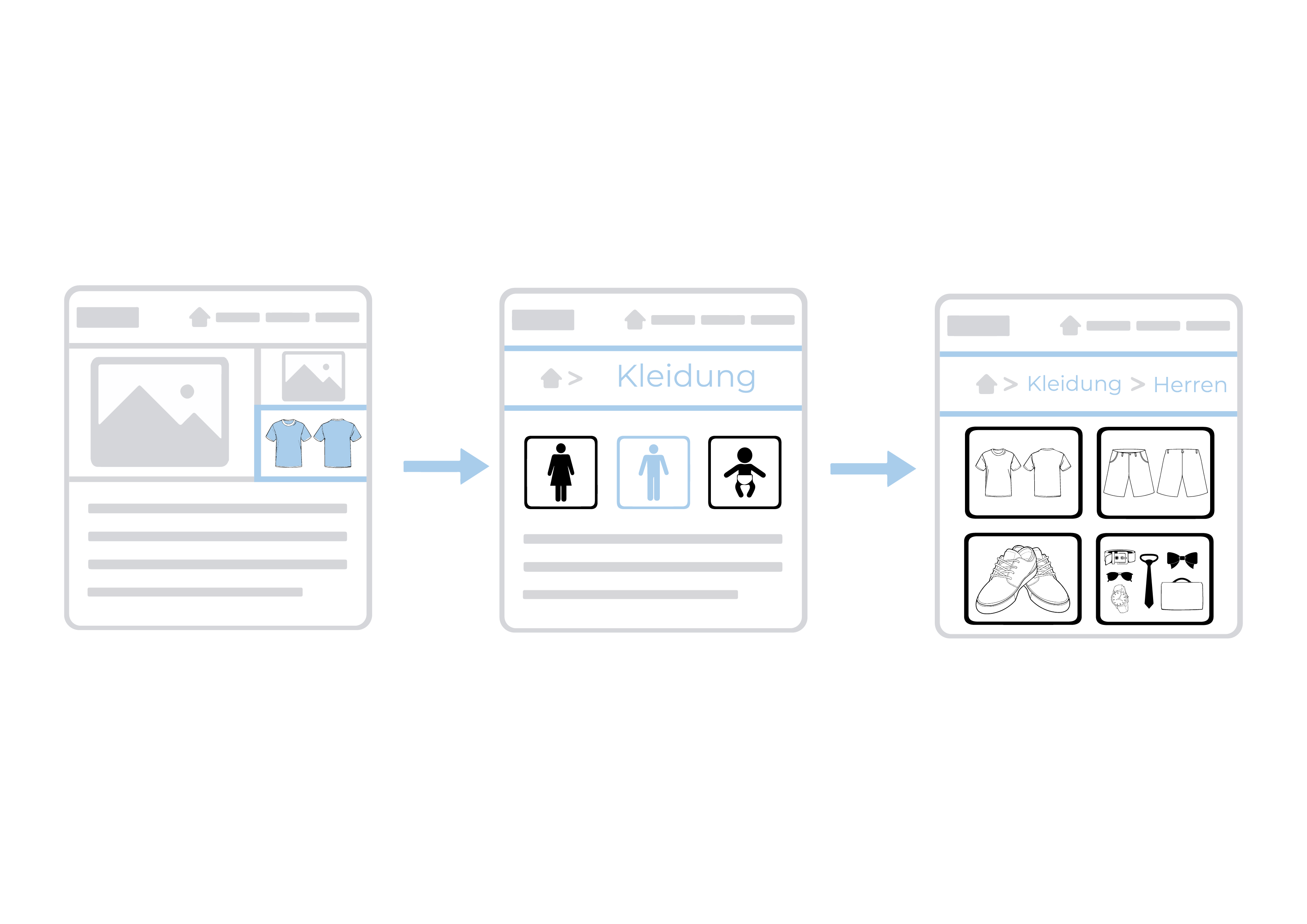

Breadcrumb-Menü: Das Erfolgsgeheimnis von Hänsel und Gretel

Breadcrumb bedeutet zu Deutsch so viel wie Brotkrümel. Die Verwendung leitet sich aus dem Märchen Hänsel und Gretel ab, bei dem die Kinder die Brotkrümel dazu verwendet haben, wieder nach Hause zurückzufinden.

Auch auf einer Webseite können Brotkrümel für entsprechende Orientierung sorgen. Sie dienen den Usern neben dem Menü als sekundäre Navigation auf der Webseite, indem sie den Besuchern verraten, wo und auf welcher Ebene der Seite sie sich gerade befinden. Vor allem bei Online-Shops kommen die Breadcrumbs sehr häufig zum Einsatz. Das sieht dann beispielsweise folgendermaßen aus:

⇒Start > Kleidung > Damen > Röcke

Das besondere Feature dabei ist, dass jedes einzelne Element anklickbar ist. Soll also schnell zur Übersicht der Damenmode allgemein gewechselt werden, reicht in diesem Fall ein Klick auf das Wort „Damen“. Besonders hilfreich ist das vor allem auch dann, wenn die User im Rahmen einer Google-Suche über eine Unterseite auf die Webseite gelangt sind.

In erster Linie sind die Breadcrumbs zwar für die Besucher der Webseite gedacht, doch auch die Google-Bots verwenden sie, um den Kontext einer Seite besser verstehen zu können.

Duplicate Content: Doppelte Inhalte finden und vermeiden

Unter dem englischen Begriff „Duplicate Content“ (deutsch: „Doppelter Inhalt“) wird im Rahmen des Technical SEO kein Vorteilspack im Supermarkt verstanden. Vielmehr ist damit das Vorhandensein von identischen Inhalten auf einer oder mehreren Webseiten gemeint.

Google kann das gar nicht leiden. Denn einerseits wittert die Suchmaschine dahinter einen plumpen Betrugsversuch, andererseits fällt es ihr schwer, selbst zu entscheiden, welche Seite sie denn nun in den SERPs an welcher Stelle anzeigen soll.

Dabei ist jedoch zwischen internem und externem Duplicate Content zu unterscheiden. Der interne Duplicate Content beschränkt sich lediglich auf die eigene Domain. Vor allem Online-Shops haben häufig damit zu kämpfen, weil oftmals Produktdetailseiten auch ohne die zugehörige Kategorie abrufbar sind.

Von externen Duplicate Content wird dann gesprochen, wenn sich idente Inhalte auf mehreren Domains finden. Das ist beispielsweise dann der Fall, wenn eine Webseite über mehrere Domainnamen erreichbar ist. In diesem Fall ist es wichtig, eine entsprechende 301-Weiterleitung einzurichten.

Es gibt unterschiedliche Möglichkeiten, Duplicate Content ausfindig zu machen. Eine davon ist die Verwendung der Google Search Console. Darüber hinaus gibt es auch noch zahlreiche Tools wie beispielsweise Siteliner (https://www.siteliner.com/) oder Copyscape (https://www.copyscape.com/), mit denen doppelte Inhalte schnell und einfach aufgefunden werden können.

Das Mittel gegen internen Duplicate Content: Canonical URLs

Bei der sogenannten „Canonical URL“ (deutsch „kanonische URL) handelt es sich um einen Meta-Tag, der Suchmaschinen dabei behilflich ist, die bevorzugte URL bei mehreren verfügbaren URLs mit dem gleichen Content zu indizieren.

Seit 2016 gibt es diese Möglichkeit für Webmaster, die Suchmaschine wissen zu lassen, welches die bevorzugte Version der jeweiligen Seite ist. Um im Rahmen des Technical SEO herauszufinden, welche Seite aktuell von Google als kanonisch betrachtet wird, hilft das URL Prüftool der Google Search Console weiter.

Doch selbst wenn eine kanonische Seite ausdrücklich festgelegt wurde, kann es trotzdem dazu kommen, dass sich Google aus unterschiedlichen Gründen anders entscheidet.

Der kanonische Tag wird innerhalb derSektion einer Webseite platziert und kann beispielsweise folgendermaßen aussehen:

⇒

Wenn keine kanonische URL angegeben wird, nimmt Google diese Aufgabe selbst in die Hand. Dabei kann es jedoch passieren, dass eine Seite ausgewählt wird, die sich nicht besonders dazu eignet. Deswegen lohnt es sich, die Kanonisierungen selbst vorzunehmen.

Strukturierte Daten erleichtern den Bots die Arbeit

Bei den strukturierten Daten handelt es sich vereinfacht ausgedrückt um Inhalte auf einer Webseite, die für die Suchmaschinen besonders gekennzeichnet werden. Den Bots erleichtert das die Einordnung der Daten.

Je mehr die Suchmaschine über die Webseite weiß, desto wahrscheinlicher ist es auch, dass sich die Rankingposition dadurch verbessert. Nicht nur das, darüber hinaus besteht dadurch auch die Möglichkeit, dass den Suchergebnissen auch noch mehr Platz eingeräumt wird. Beispielsweise, indem sie als sogenannte „Rich Snippets“ dargestellt werden.

Deshalb handelt es sich bei den strukturierten Daten ebenfalls um eine wichtige Aufgabe aller, die mit Technical SEO beschäftigt sind. Die Arbeit wird in diesem Fall dadurch erleichtert, dass sich die Unternehmen Google, Microsoft, Yahoo und Yandex zusammengesetzt haben, um sich auf einen Standard zu einigen. Herausgekommen sind dabei mit JSON-LD, Microdata und RDFa drei unterschiedliche Möglichkeiten zur Strukturierung, bei denen die jeweiligen Codes direkt in der Webseite platziert werden. Bei JSON-LD handelt es sich dabei um die von Google empfohlene Variante. Der Code kann dabei als JavaScript im Head und im Body eingepflegt werden.

Mit strukturierten Daten ist es beispielsweise möglich, die genauen Unternehmensdaten oder Informationen zu Veranstaltungen an die Suchmaschinen zu übermitteln. Oft wird diese Methodik auch dazu genutzt, seine Produkte mit entsprechenden Informationen anzureichern oder die Breadcrumbs direkt bei den Suchergebnissen anzeigen zu lassen.

Besondere Aufmerksamkeit durch Rich-Suchergebnisse

Ob die strukturierten Daten auch tatsächlich in den Suchergebnissen verarbeitet werden, obliegt den Betreibern der Suchmaschine. Doch eines ist klar: Wer darauf verzichtet, vergibt die Chance darauf in jedem Fall, ganz oben in der SERP als Rich Snippet zu erscheinen.

Bei den Rich Snippets handelt es sich um eine Erweiterung jener Snippets, die in früheren Zeiten ausschließlich zur Darstellung der Suchergebnisse verwendet wurden. Der ursprüngliche Aufbau aus Titel, Beschreibung und URL wird bei den Rich Snippets auf unterschiedliche Art und Weise erweitert.

Zu den populärsten Varianten zählen dabei spezielle Elemente wie beispielsweise Abbildungen, Preisangaben zu Produkten und Bewertungssysteme.

Bedeutung für Technical SEO haben die Rich Snippets vor allem deshalb, weil sie eine wichtige Rolle bei der Entwicklung der Klickraten eines Suchergebnisses spielen. Die entsprechende Kennzahl nennt sich in der Fachsprache Click-Through-Rate (CTR) und ist ein wichtiger Faktor für das Ranking einer Webseite. Die Rich Snippets stechen unter den „normalen“ Suchergebnissen heraus und werden deshalb besonders häufig geklickt.

Das Featured Snippet liefert konkrete Antworten auf einfache Fragen

Die Suchmaschinen haben grundsätzlich die Intention, das Sucherlebnis der User zu verbessern. Das Ziel dabei ist es, den Suchenden so schnell und einfach wie möglich eine Antwort auf ihre Frage zu liefern. Zu diesem Zweck kommen bei Google sogenannte Features Snippets zum Einsatz, die direkt in der Suchmaschine eine direkte und prägnante Antwort auf eine Frage geben.

Unter dem Antworttext ist in weiterer Folge die Antwortquelle angegeben. Im deutschsprachigen Raum hat oftmals Wikipedia die Featured Snippets für sich gepachtet, doch wer gute und einfache Antworten auf die unterschiedlichsten Fragen liefert, hat gute Chancen, ebenfalls gelistet zu werden.

Die schlechte Nachricht im Rahmen des Technical SEO lautet jedoch, dass sich die Ergebnisse nicht so wie etwa Rich Snippets durch die Eingabe von strukturierten Daten steuern lassen. Letztendlich entscheidet der Suchmaschinen-Betreiber selbst, welche Antwort die Beste ist.

Bei den Featured Snippets wird aktuell zwischen drei Varianten unterschieden:

- Text-Snippets: Dabei handelt es sich um die klassische Form mit einfachen Antworten in Textform.

- Video-Snippets: Hier wird statt der schriftlichen Beantwortung ein Video vorgeschlagen, das als Antwort auf die jeweilige Frage dienen soll.

- Listen- und Tabellen-Snippets: Diese liefern die einzelnen Schritte, um zu einem bestimmten Ergebnis zu gelangen. Beispielsweise, wie Eier zubereitet oder die Kette beim Fahrrad geölt werden kann.

Passage Ranking

Bei Passage Ranking handelt es sich um eine der jüngsten Weiterentwicklungen von Google. Für das Technical SEO ist sie vor allem deshalb von Bedeutung, weil viele die genaue Funktionsweise noch nicht kennen.

Das Ziel von Google dabei ist es, die Qualität der Antworten in den Suchergebnissen im Vergleich zu den Featured Snippets deutlich anzuheben. Das funktioniert, indem der Algorithmus die Inhalte auf den Webseiten nun noch genauer durchsucht als bisher. Bei Passage Ranking geht es allerdings nicht um eine verbesserte Darstellung der Ergebnisse in der Suchmaske, sondern vielmehr um die Logik dahinter.

Dazu ist es wichtig, sich ein wenig Grundwissen über die einzelnen Updates von Google in den letzten Jahren anzueignen. Im Rahmen des Updates „BERT“ aus dem Jahr 2019 hat der Algorithmus gelernt, Wörter nicht nur für sich allein zu betrachten, sondern in den richtigen Kontext zu setzen. Die Technik dahinter heißt „Natural Language Processing“ und sorgt mit verschiedenen Methodiken aus der Sprachwissenschaft dafür, die Kommunikation zwischen Menschen und Maschinen zu verbessern.

Das ist vor allem deshalb erforderlich, weil die menschliche Sprache im Gegensatz zu jener von Maschinen mehrdeutig ist.

Vom Passage-Ranking profitieren vor allem die Anbieter von umfangreichen Webseiten mit einer Fülle unterschiedlicher Informationen. Im Gegensatz zu früher haben diese nun die Chance, im Rahmen des Passage Ranking mit dem entsprechenden Textauszug auf der Webseite in Google gelistet zu werden und so den Vorzug gegenüber einer Special Interest-Seite zu erhalten, die sich ausschließlich nur einem bestimmten Thema widmet.

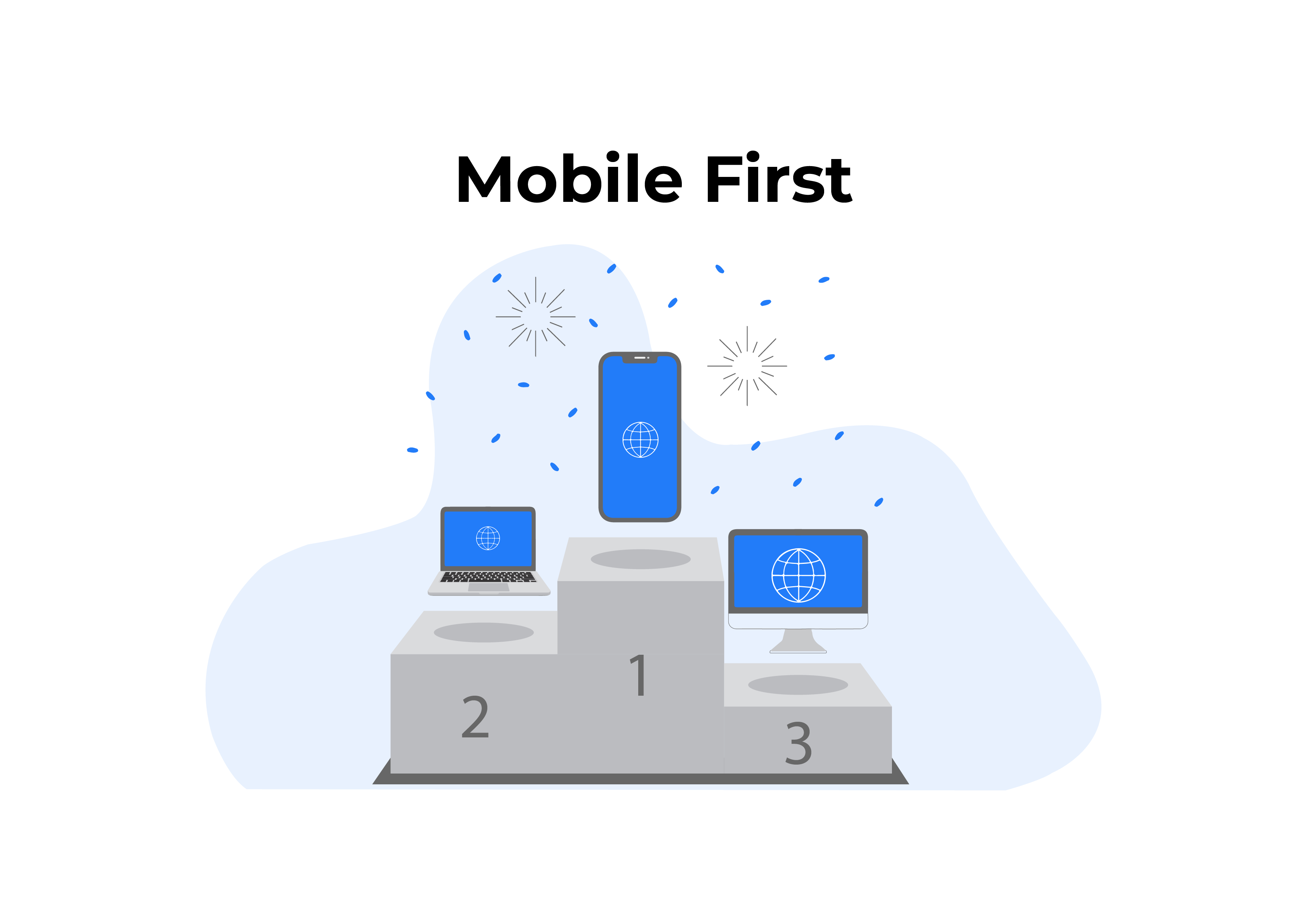

Mobile First: Webseiten werden primär für Smartphones entwickelt

Das Nutzungsverhalten der User zeigt, dass immer mehr Menschen mit dem Smartphone oder dem Tablet im Internet surfen und nicht mehr mit dem Laptop oder dem Desktop-PC. Das hat auch dazu geführt, dass sich die Entwicklung umgekehrt hat.

Der Begriff „Mobile First“ bedeutet somit, dass bei der Konzeption der Webseiten nun zunächst die mobile Version entsteht und erst im Anschluss daran Erweiterungen für die Komplettnutzung auf dem PC erfolgen. Dieses Vorgehen folgt somit auch den Prinzipien des agilen Projektmanagements mit seiner iterativen Arbeitsweise.

Was bedeutet das aber nun für das Technical SEO? Im Jahr 2016 hat sich Google dazu entschlossen, die „Mobile Friendliness“ (also das optimierte Nutzungsverhalten für Mobilgeräte) zum Rankingfaktor in den SERPs zu machen. In weiterer Folge wurde der mobile Index zum primären Index erhoben. Das bedeutet, dass nun statt den Desktopversionen die mobilen Webseiten von den Crawlern durchsucht werden.

Dadurch nehmen vor allem Elemente wie beispielsweise die Suche via Spracheingabe sowie der Page Speed an Bedeutung zu. Für Webentwickler bedeutet das, ihre grundsätzliche Denkweise zu ändern und entsprechende Features nicht als Add-On im Projekt zu sehen, sondern von Anfang an in die Grundstruktur der Seite einzuplanen.

Accelerated Mobile Pages (AMP) sind der neue Standard

Um der Entwicklung von „Mobile First“ Rechnung zu tragen, wurden Accelerated Mobile Pages ins Leben gerufen. Dabei handelt es sich um speziell für Smartphones und Tablets optimierte Webseiten, die mit Hilfe einer eigens dafür entwickelten HTML-Version erstellt werden können. Der Clou dabei: Durch die Limitierung bestimmter Elemente einer Webseite wird das Lesen bereits während dem Ladevorgang ermöglicht.

Google gibt zwar an, dass AMP an sich kein Ranking-Faktor bei der Google-Suche ist, sehr wohl aber die Geschwindigkeit. Und hier ist AMP klar im Vorteil. Denn damit können Publisher ihren Content wesentlich schneller auf den mobilen Endgeräten darstellen.

Sucht man auf mobilen Geräten nach Nachrichtenthemen, werden diese von Google in einem sogenannten Nachrichten-Karussell dargestellt. Die AMP Inhalte werden mit einem gelben Blitz entsprechend gekennzeichnet. Genau das kann dazu führen, dass User bevorzugt diese Seiten anklicken und sich damit wieder die Click-Through-Rate (CTR) erhöht. Genau aus diesem Grund ist AMP auch für Technical SEO relevant.

Ohne SSL-Zertifikat geht gar nichts mehr

Die Sicherheit spielt eine immer wichtigere Rolle beim Surfen im Internet. Gehackte E-Mail Accounts von Politikern in Wahlkämpfen sowie zahlreiche Berichte über Datenklau haben die User in dieser Hinsicht in den letzten Jahren stark sensibilisiert.

Das ist auch den Suchmaschinen-Betreibern bekannt. Deshalb haben sie die Sicherheit zu einem Ranking-Faktor gemacht. Bei Google ist das „https“ schon seit dem Jahr 2014 ein Kriterium für ein gutes Listing in den SERPs. Seit dem Jahr 2017 werden diese Seiten von Google auch entsprechend gekennzeichnet, indem das „https“ beim entsprechenden Suchergebnis mitgeliefert wird.

Hinter der Abkürzung „SSL“ verbirgt sich der Begriff “Secure Socket Layer”. Damit gemeint ist das Verschlüsselungsprotokoll, das bei einer Webseite zum Einsatz kommt. Der Einsatz von SSL sorgt dafür, dass die Datenübertragung verschlüsselt stattfindet und entsprechend sicher ist.

Die SSL-Zertifikate sind in drei unterschiedlichen Vertrauensstufen erhältlich. Nach Möglichkeit sollte dabei mit der Extended Validation (EV) die höchste Verschlüsselungsstufe gewählt werden, durch die die Besucher die Sicherheit erhalten, dass die Webseite tatsächlich vom jeweiligen Unternehmen betrieben wird und Verbindungen mit der Domain sicher sind.

Bilder-SEO: Eine vernachlässigte Disziplin bei der Optimierung

Bilder mit Alt-Tags zu versehen, gehört zu den Pflichtübungen des Technical SEO. Doch damit ist die Optimierung in diesem Fall noch lange nicht abgeschlossen.

Viele sehen in der Bildoptimierung nur eine lästige Pflichtübung und vernachlässigen sie deshalb sträflich. Die echten Profis gehen jedoch über die Anreicherung der Bilder mit Alt-Attributen hinaus.

Für SEO ist das relevant, weil auch immer häufiger Bilder in den Suchergebnissen dargestellt werden. Oftmals werden sie sogar über allen anderen organischen „Blue Links“ angezeigt.

Vor allem die Dateigröße bei Bildern wirkt sich oftmals negativ auf den PageSpeed aus. Der Download dauert entsprechend lange und erhöht die Ladezeit der Webseite insgesamt. Die Konsequenz davon ist bereits bekannt: Eine entsprechende Schlechterstellung in den SERPs.

Genau deshalb ist es wichtig, die Bildgröße auf die Anzeigegröße zu reduzieren. Tools dafür sind nahezu unendlich vorhanden und reichen vom professionellen Photoshop bis zu Canva.

Auch für die Bilder kann eine eigene Sitemap erstellt werden. Das erhöht die Wahrscheinlichkeit, dass die Bilder in den Suchergebnissen dargestellt werden, zusätzlich.

Echte Pros hosten ihre Bilder in einem CDN (Content Delivery Network). Damit sind die Bilder auf mehreren Servern weltweit gespeichert und ermöglichen jedem Nutzer die Bereitstellung der Bilder von einem nahegelegenen Server.

Text-Formatierung: Das ist doch Content-Marketing, oder?

Grundsätzlich ist die Text-Formatierung Aufgabe des Content-Marketings. Dennoch ist es auch im Technical SEO wichtig, immer ein Auge darauf zu haben. Denn nicht immer halten sich die Schreiber bei der Erstellung ihrer Inhalte an wichtige Vorgaben und denken dabei nicht an die Seitenstruktur und die Klicktiefe, die jedoch einen entscheidenden Einfluss auf das Ranking haben.

Vor allem die Gliederung des Textes hat dabei einen sehr großen Stellenwert. Deshalb ist es wichtig, die Inhalte mit entsprechenden Überschriften zu versehen. Bei einem Text bis etwa 300 Wörtern ist eine Hauptüberschrift, die sogenannte H1-Überschrift ausreichend.

Bei längeren Texten ist es wichtig, bei jedem neuen Themen-Abschnitt eine H2-Überschrift einzufügen. Unterpunkte können darüber hinaus in H3- und H4-Überschriften hierarchisch gegliedert werden. Wichtig dabei ist es, sich nicht in den Ebenen zu verlieren.

Eine der wichtigsten Maßnahmen im Rahmen von SEO ist internes Linkbuilding. Hier gilt es beim Technical SEO vor allem zu überprüfen, ob die entsprechenden Vorgaben eingehalten werden.

Besonders negativ wirken sich unter anderem fehlende Aktualisierungen von Links auf die Suchergebnisse aus. Entsprechende Linkchecker-Tools helfen in diesen Fällen, Broken Links schnell aufzuspüren.

Fazit: Technical SEO ist ein wichtiger Baustein auf dem Weg zum Erfolg.

Wer mit Technical SEO beschäftigt ist, wird schnell bemerken, dass das Thema niemals abgeschlossen ist. Denn einerseits führen laufende Veränderungen im Algorithmus der Suchmaschinen dazu, dass auf der eigenen Webseite ständig nachgebessert werden muss.

Und andererseits sind die meisten Webseiten dynamisch gestaltet und werden dauernd mit neuen Inhalten erweitert. Jede dieser Erweiterungen kann eine Auswirkung auf die Darstellung in den SERPs haben und muss deshalb genauestens analysiert werden.

Perfektionisten verzweifeln oftmals an dieser Tätigkeit. Denn die technisch einwandfrei suchmaschinenoptimierte Webseite ist ein sehr hochgestecktes Ziel, das in der Praxis eigentlich nicht erreichbar ist.

Deshalb ist es sinnvoll, sich im Rahmen von Technical SEO entsprechende Ziele zu setzen und in regelmäßigen Abständen ein entsprechendes Audit durchzuführen, bei dem die Inhalte der Webseite genauestens durchleuchtet werden.

Vor allem gilt es, die Kollegen im Content Marketing entsprechend zu sensibilisieren, dass es sich beispielsweise bei der Optimierung eines Bildes nicht um ein nettes Add-On handelt, sondern in letzter Konsequenz darüber entscheiden kann, ob ein potenzieller Kunde auf den Link des eigenen Unternehmens oder jenen eines Mitbewerbers klickt.

Im Wiederholungsfall können so über das Jahr verteilt Tausende von möglichen Käufern verloren gehen. Umgekehrt betrachtet kann eine exzellente technische Optimierung jedoch auch dazu führen, dass die Umsätze florieren. Technical SEO ist zwar nicht das einzige Kriterium auf dem Weg zum Erfolg, aber ein wichtiger Baustein.

Einzelnachweise

SEO: Technisches SEO

Author:Jakob Friesen

Datum:09.09.2021

Inhaltsverzeichnis

- Was ist technisches SEO?

- Das Herzstück von Technical SEO: Die Google Search Console

- robots.txt: Die erste Anlaufstelle für Crawler

- URL-Struktur: So lang wie nötig, so kurz wie möglich

- Eine gute Struktur der Webseite verbessert die Crawl-Effizienz

- Seitenstrukturierung mit XML-Sitemap und HTML-Sitemap

- Mit Hilfe von Metatags mit den Suchmaschinen kommunizieren

- Weiterleitungen: Das virtuelle „Wir sind umgezogen“-Schild

- Jede Millisekunde zählt: Pagespeed verbessern

- Breadcrumb-Menü: Das Erfolgsgeheimnis von Hänsel und Gretel

- Duplicate Content: Doppelte Inhalte finden und vermeiden

- Das Mittel gegen internen Duplicate Content: Canonical URLs

- Strukturierte Daten erleichtern den Bots die Arbeit

- Besondere Aufmerksamkeit durch Rich-Suchergebnisse

- Das Featured Snippet liefert konkrete Antworten auf einfache Fragen

- Passage Ranking

- Mobile First: Webseiten werden primär für Smartphones entwickelt

- Accelerated Mobile Pages (AMP) sind der neue Standard

- Ohne SSL-Zertifikat geht gar nichts mehr

- Bilder-SEO: Eine vernachlässigte Disziplin bei der Optimierung

- Text-Formatierung: Das ist doch Content-Marketing, oder?

- Fazit: Technical SEO ist ein wichtiger Baustein auf dem Weg zum Erfolg.

Informationen oder haben

sonstige Fragen?

Klicken Sie auf eine der Kontaktmöglichkeiten - wir freuen uns über Ihren Kontakt!